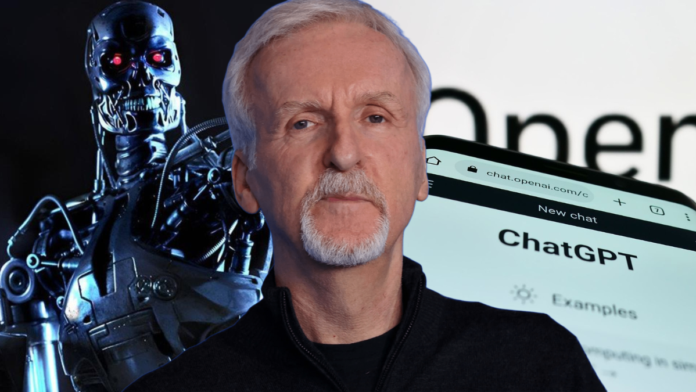

El director de “The Terminator”, James Cameron, manifestó su preocupación por el riesgo real de que la trama de su película se vuelva realidad. Esto tras los últimos avances en inteligencia artificial.

En una entrevista con Rolling Stone, advirtió sobre los peligros de que la IA se combine con sistemas armamentísticos y de defensa nuclear, temiendo por un posible apocalipsis nuclear.

“Creo que todavía existe el peligro de un apocalipsis al estilo de Terminator donde se junta la IA con sistemas de armas, incluso a nivel de armas nucleares…”, James Cameron, Rolling Stone 2025.

La rapidez con la que se toman decisiones militares automatizadas puede superar la capacidad humana para supervisarlas, aumentando el riesgo de errores catastróficos.

Te puede interesar: Open AI lanza Chat GPT-5, su modelo de IA más avanzado

El cineasta explicó que “se necesitaría una superinteligencia para procesar” la velocidad de las operaciones en los centros de mando, pero los humanos, quienes habitualmente supervisan esos sistemas, son falibles y se han cometido errores.

Asimismo, indicó que la humanidad enfrenta tres amenazas existenciales simultáneas: el cambio climático, las armas nucleares y la inteligencia artificial avanzada.

Pese a esto, consideró que la superinteligencia podría ser una posible solución; no obstante, reconoció tener incertidumbre sobre ello.

La franquicia de “Terminator” se centra en la guerra entre la inteligencia artificial conocida como Skynet y la humanidad, liderada por John Connor, en un futuro donde las máquinas lideran el mundo.